AI技術の進化は素晴らしい恩恵をもたらす一方で、新たな脅威も生み出しています。その代表格が「ディープフェイク」です。

まるで本人が喋っているかのような偽の動画や、実在しない人物の精巧な顔写真…。これらは今や、スマートフォンのアプリで誰でも簡単に作れてしまう時代です。

この記事では、生成AIパスポート試験でも重要な倫理・リスク分野のキーワードである「ディープフェイク技術」と、それによって引き起こされる「偽情報(ディスインフォメーション)」の問題について解説します。

ディープフェイクとは

ディープフェイク(Deepfake)とは、「ディープラーニング(深層学習)」と「フェイク(偽物)」を組み合わせた造語です。

AIの画像生成技術や音声合成技術を使って作られた、「本物そっくりの偽データ(動画、画像、音声)」のことを指します。

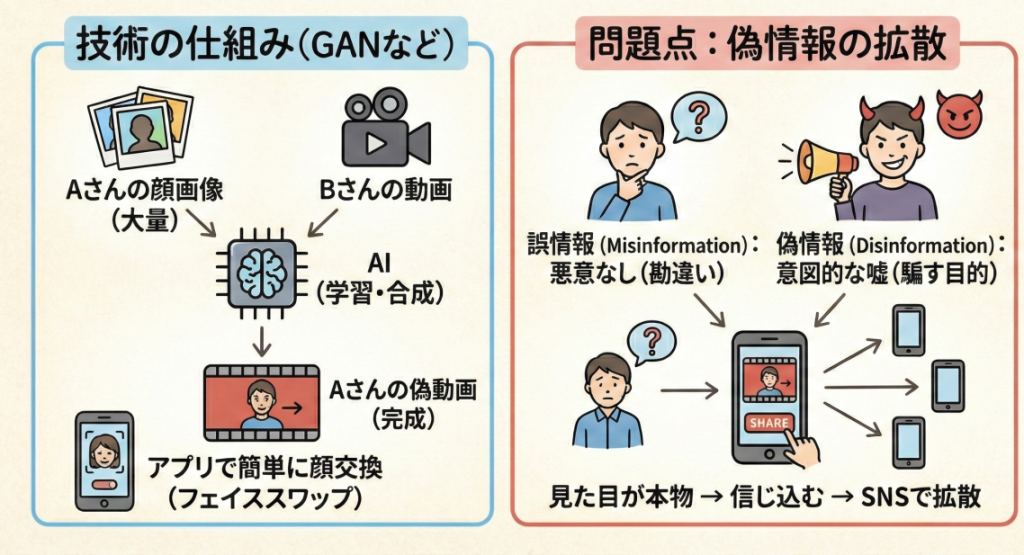

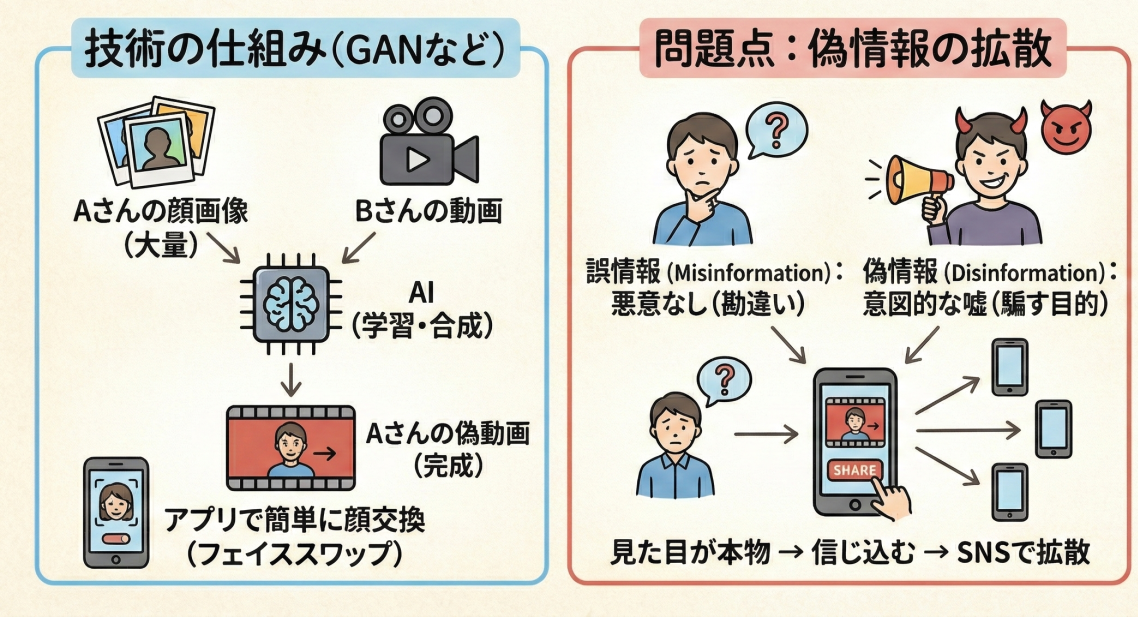

技術の仕組み

主にGAN(敵対的生成ネットワーク)などのAI技術が使われます。

大量の「Aさんの顔画像」と「Bさんの動画」をAIに学習させ、Bさんの動きに合わせてAさんの顔を合成することで、あたかもAさんが喋っているような動画を作り出します。

以前はハリウッド映画のような高度な技術が必要でしたが、現在はアプリで簡単に顔交換(フェイススワップ)ができるようになり、悪用へのハードルが下がってしまいました。

偽情報(ディスインフォメーション)の拡散

ディープフェイクが問題視される最大の理由は、偽情報(ディスインフォメーション)の拡散に使われるからです。

- 誤情報(Misinformation):悪意はなく、間違って広まってしまった情報(勘違いなど)。

- 偽情報(Disinformation):人々を騙したり、混乱させたりするために、意図的に作られた嘘の情報。

ディープフェイクは、見た目が本物に見えるため、人々が信じ込みやすく、SNSであっという間に拡散されてしまいます。「百聞は一見に如かず」という人間の心理を逆手に取った、非常に危険な攻撃手段と言えます。

ディープフェイクによる事件

ディープフェイクが悪用されると、具体的にどのような事件が起きるのでしょうか。世界中で起きている事例をいくつか紹介します。

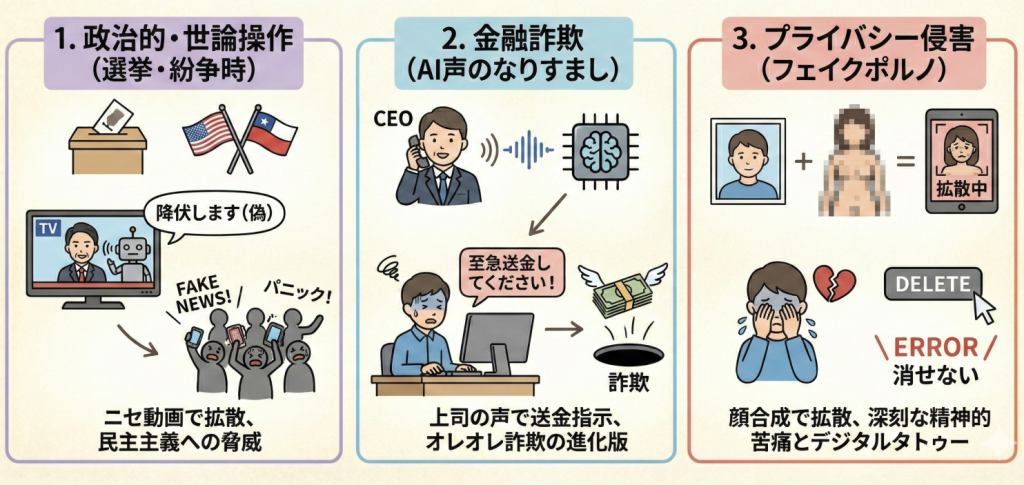

政治的な工作・世論操作

選挙期間中や紛争時に、政治家や国のリーダーが「降伏を宣言する動画」や「不適切な発言をしている動画」が偽造され、SNSで拡散される事件が発生しています。

これにより、国民がパニックになったり、選挙の結果が歪められたりする恐れがあり、民主主義への脅威となっています。

金融詐欺(オレオレ詐欺の進化版)

企業のCEO(社長)の声をAIで完璧に再現し、部下に電話をかけて「至急、この口座に送金してくれ」と指示を出す詐欺事件も起きています。

電話越しの声が上司そのものだったら、疑うのは難しいですよね。これが「AIを使ったなりすまし詐欺」です。

個人の尊厳やプライバシーの侵害

有名人や一般人の顔写真を、アダルトビデオの出演者の体に合成する「フェイクポルノ」が深刻な問題になっています。

これは明らかな人権侵害であり、被害者の精神的苦痛は計り知れません。法整備が進められていますが、一度ネットに流出すると完全に消すのは難しく、大きな社会問題となっています。

まとめ

今回の記事では、ディープフェイク技術のリスクについて解説しました。

- ディープフェイク(深層偽造):AIで作られた「本物そっくりの偽物」。

- 偽情報(ディスインフォメーション):悪意を持って拡散される嘘の情報。

- 政治的なデマ、詐欺、人権侵害などに悪用されるリスクが高い。

AIを使う側(私たち)には、「動画だからといって本物とは限らない」と疑う姿勢(メディアリテラシー)が求められています。試験でも「ディープフェイクのリスク」は必ず問われるテーマですので、事例とセットで覚えておきましょう。

コメント