ChatGPTなどの生成AIを使っていると、「LLM(大規模言語モデル)」という言葉をよく耳にすると思います。

「普通の言語モデル(LM)と何が違うの?」

「Temperature(温度)って設定項目があるけど、どう変えればいいの?」

これらは、AIを使いこなす上で非常に重要な基礎知識です。この記事では、AIが言葉を操る仕組みである「LM」と「LLM」の違い、そしてAIに意図通りの回答をさせるための技術「プロンプトエンジニアリング」について、専門用語を噛み砕いて解説します。

LM(Language Model : 言語モデル)

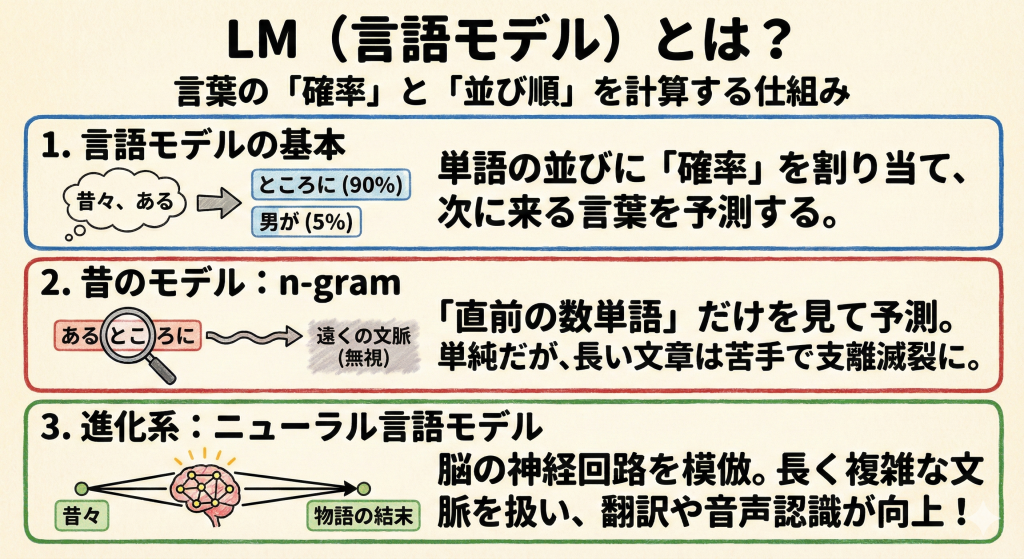

LM(言語モデル)とは、単語や文字の並びに対して「確率」を割り当て、文章の自然さや次に来る言葉を予測する数理モデルのことです。

簡単に言うと、「言葉の並び順のルールを計算する仕組み」です。

昔のモデル:n-gramモデル

初期の言語モデルにn-gram(エヌグラム)モデルがあります。

これは、「直前の数単語(n個の単語)」だけを見て、次に来る確率が高い単語を予測する単純な仕組みです。

- 「昔々、ある」の次は…「ところに(90%)」「男が(5%)」

シンプルですが、遠く離れた文脈(例えば、物語の冒頭の設定など)を考慮できないため、長い文章を作ると支離滅裂になりがちでした。

進化系:ニューラル言語モデル

その後、人間の脳の神経回路を模したニューラルネットワークを使うことで、より長く複雑な文脈を扱えるニューラル言語モデルが登場し、翻訳や音声認識の精度が向上しました。

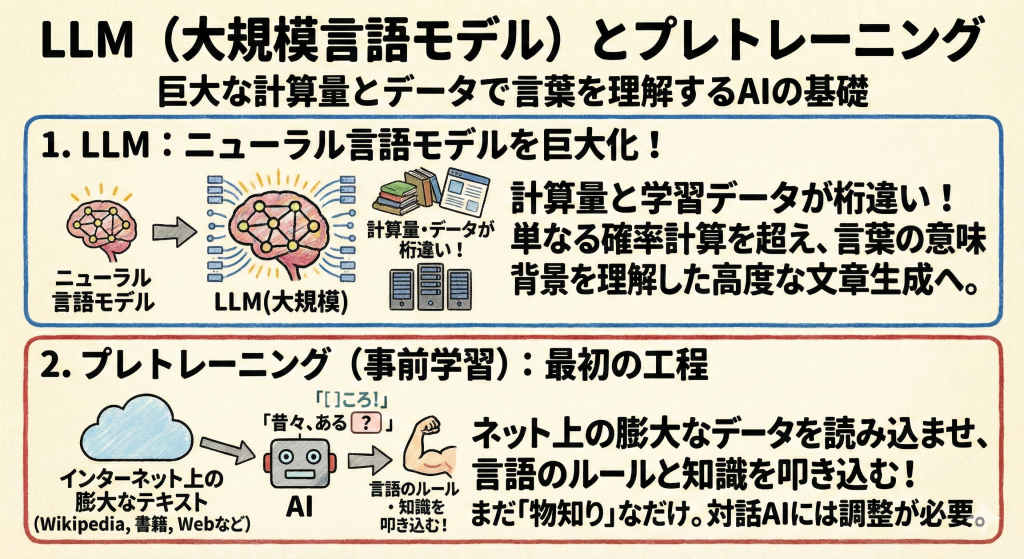

LLM(Large Language Model: 大規模言語モデル)

ニューラル言語モデルを、とてつもなく巨大にしたのがLLM(大規模言語モデル)です。

「大規模」とは、計算量(パラメータ数)と学習データの量が桁違いに多いことを意味します。

何千億もの単語を読み込ませることで、単なる確率計算を超えて、まるで言葉の意味や背景知識を理解しているかのような高度な文章生成が可能になりました。

プレトレーニング(事前学習)

LLMを作るための最初の工程をプレトレーニングと呼びます。

インターネット上の膨大なテキストデータ(Wikipediaや書籍、Webサイトなど)をAIに読み込ませ、「次に来る単語は何か?」という穴埋め問題を延々と解かせることで、言語のルールや一般的な知識を叩き込みます。

この段階では「物知りなAI」にはなりますが、まだ人間の指示に従順ではありません。ここからさらに調整(ファインチューニング)を行って、ChatGPTのような対話AIが作られます。

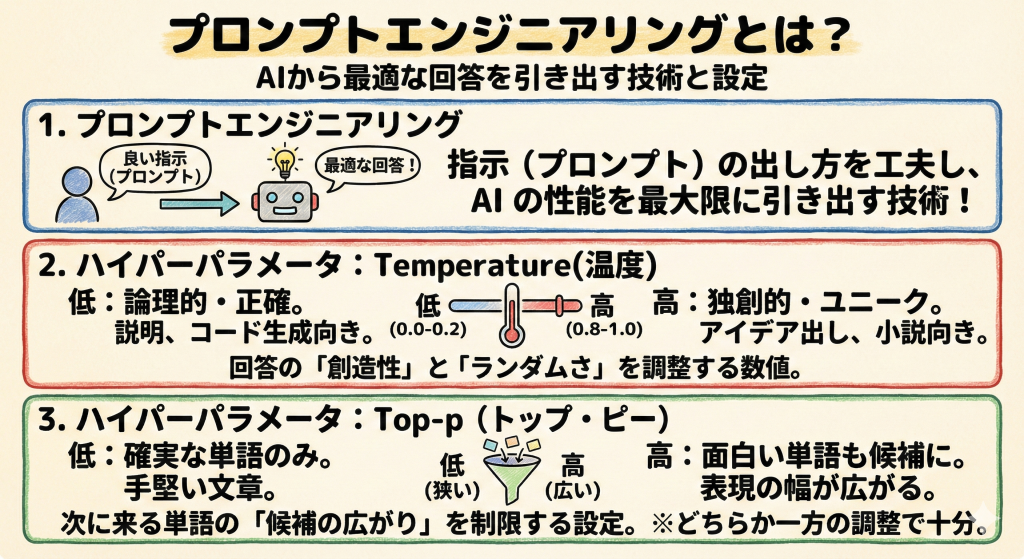

プロンプトエンジニアリング

高性能なLLMができても、使い方が悪ければ良い答えは返ってきません。

AIに対する指示文のことをプロンプトと呼び、この指示の出し方を工夫して、AIから最適な回答を引き出す技術をプロンプトエンジニアリングと呼びます。

ハイパーパラメータの設定

プロンプトエンジニアリングには、言葉選びだけでなく、AIの「性格」を決める数値設定(ハイパーパラメータ)の調整も含まれます。

特に試験で重要なのが、回答の「ランダム性」を制御する以下の2つのパラメータです。

1. Temperature(温度)

AIの回答の「創造性」や「ランダムさ」を調整する数値です。

- 数値を高くする(0.8〜1.0):回答がバラつきやすくなり、独創的でユニークな文章が生成されやすくなります。アイデア出しや小説の執筆に向いています。

- 数値を低くする(0.0〜0.2):確率が最も高い単語だけを選ぶようになり、論理的で正確な文章になります。事実に基づく説明や、プログラミングコードの生成に向いています。

2. Top-p(トップ・ピー)

Temperatureと似ていますが、こちらは「次に来る単語の候補をどこまで広げるか」を制限する設定です。

- 数値を低くする:「確率上位の確実な単語」しか使わなくなるため、手堅い文章になります。

- 数値を高くする:「確率は低いけれど面白い単語」も候補に入れるため、表現の幅が広がります。

※一般的に、TemperatureとTop-pはどちらか一方を調整すれば十分とされています。

まとめ

今回の記事では、言語モデルとプロンプト技術の基礎を解説しました。

- LM(言語モデル):言葉の確率を計算する仕組み。昔はn-gram、今はニューラル言語モデルが主流。

- LLM(大規模言語モデル):大量のデータでプレトレーニングを行い、高度な理解力を持ったモデル。

- プロンプトエンジニアリング:AIへの指示出し技術。

- Temperature:高いと「創造的(ランダム)」、低いと「論理的(正確)」になる重要な設定値。

試験では「正確な情報を得たいときはTemperatureをどう設定すべきか?(答え:低くする)」といった実践的な問題が出やすいので、パラメータの意味をしっかり覚えておきましょう!

コメント