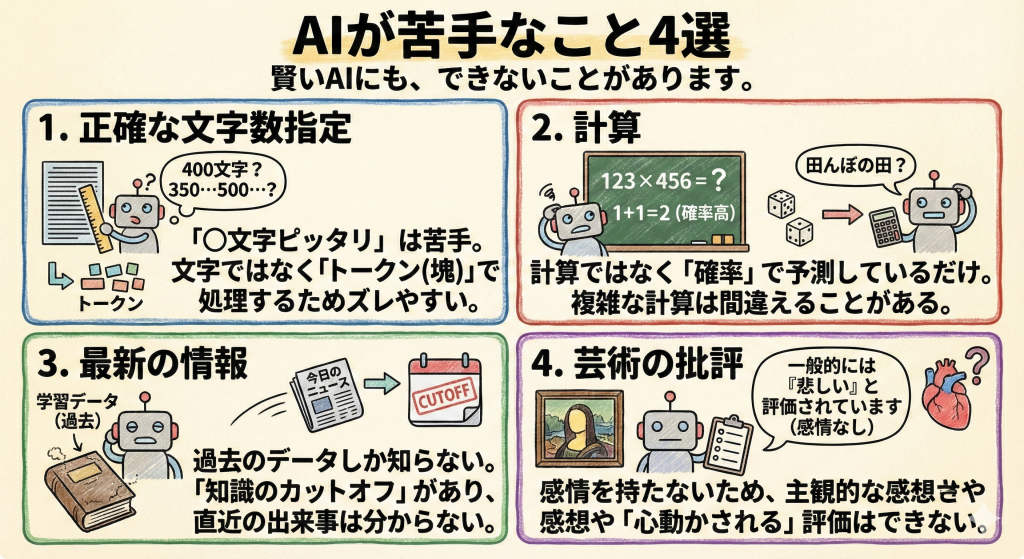

「AIにお願いしたのに、指定した文字数と全然違う…」

「簡単な計算なのに間違っている…」

生成AIを使っていると、意外なところでミスをすることに気づくかもしれません。

実は、AIは万能の神様ではなく、構造的にどうしても苦手な分野が存在します。

この記事では、テキスト生成AIを使う上で知っておくべき「4つの弱点(不得意なこと)」について解説します。

「何ができて、何ができないのか」を正しく理解することは、AIをビジネスで使いこなすための第一歩です。

正確な文字数の指定

「400文字ピッタリで感想文を書いて」と頼んでも、AIはしばしば350文字だったり、500文字だったりとズレた回答をしてきます。

なぜ、あれほど賢いAIが文字数を数えられないのでしょうか?

その理由は、AIが人間のように「文字(あ、い、う…)」単位で文章を読んでいないからです。

- 人間:1文字ずつ数えることができる。

- AI:「トークン」というデータの塊(単語や文字の断片)で処理している。

特に日本語の場合、「1トークン=何文字」という換算が複雑で変動するため、AIは正確な文字数をコントロールするのが非常に苦手です。

「だいたい400文字くらい」という指示なら通じますが、厳密な文字数制限が必要な場合は、生成後に人間が調整する必要があります。

計算

「コンピュータなんだから計算なんてお手の物でしょう?」と思われがちですが、実はテキスト生成AI(LLM)単体では計算が苦手です。

言語モデルは、あくまで「次に来る確率が高い言葉」を予測しているだけです。

例えば、「1 + 1 =」の次に「2」と答えるのは、計算したからではなく、学習データの中に「1+1=2」というパターンがたくさんあったから、「次は2が来る確率が高い」と予測したに過ぎません。

そのため、3桁×3桁のような複雑な掛け算や、桁数の多い足し算をさせると、もっともらしい顔をして平気で間違った答え(ハルシネーション)を出力することがあります。

対策:

正確な計算が必要な場合は、ChatGPTの「Code Interpreter」機能を使うか、Excelなどの表計算ソフトを使いましょう。

最新の情報

生成AIは、過去に学習したデータ(教科書)の中に答えを探しに行きます。

そのため、学習データに含まれていない「直近の出来事」や「未来のこと」は知りません。

これを「知識のカットオフ(期限)」と呼びます。

例えば、2023年までしか学習していないAIに「今日の東京の天気は?」や「昨日の野球の試合結果は?」と聞いても、答えられなかったり、過去のデータから適当に嘘をついたりします。

対策:

最新情報を知りたい場合は、検索エンジンと連携したAI(CopilotやGemini、ChatGPTの検索機能など)を使うか、RAG(検索拡張生成)の仕組みを利用する必要があります。

芸術の批評

「この絵を見て感動しましたか?」

「この詩の味わい深さを解説して」

こうした「主観的な感性」や「感情」が必要な評価も、AIは苦手です。

AIは感情を持っていません。AIが出してくる芸術批評は、あくまで「世の中で一般的にどう評価されているか」という情報のパッチワークです。

「多くの人が『悲しい』と評しています」という事実は述べられますが、AI自身が心動かされて涙を流すわけではありません。

「あなたはどう思う?」という個人の感性が問われる領域は、依然として人間だけの特権と言えるでしょう。

まとめ

今回の記事では、テキスト生成AIの不得意な分野について解説しました。

- 文字数指定:「トークン」で処理しているため、正確なカウントが苦手。

- 計算:「予測」しているだけなので、複雑な計算は間違えることがある。

- 最新情報:学習データの期間外(カットオフ後)のことは知らない。

- 芸術批評:主観や感情がないため、独自の感性による評価はできない。

試験では「AIに任せても良い作業はどれか?(計算や最新ニュースの確認はNG)」といった判断力が問われます。AIの弱点を知り、人間がうまくフォローすることで、より良い成果物を作っていきましょう!

コメント