生成AIブームの火付け役となった「ChatGPT」。今や仕事や学習に欠かせないツールですが、その裏側にある技術や、モデルごとのカタログスペック(性能指標)の違いを正しく理解していますか?

「GPT-3.5とGPT-4は何が違うの?」「GPT-o1って何?」といった疑問は、生成AIパスポート試験でも頻出のポイントです。

この記事では、ChatGPTの仕組みや歴史、そして次々と登場する最新モデルの具体的な性能(パラメータ数や一度に読み込める文章量など)について、比較表を交えながら初心者にもわかりやすく解説します。

ChatGPTとは

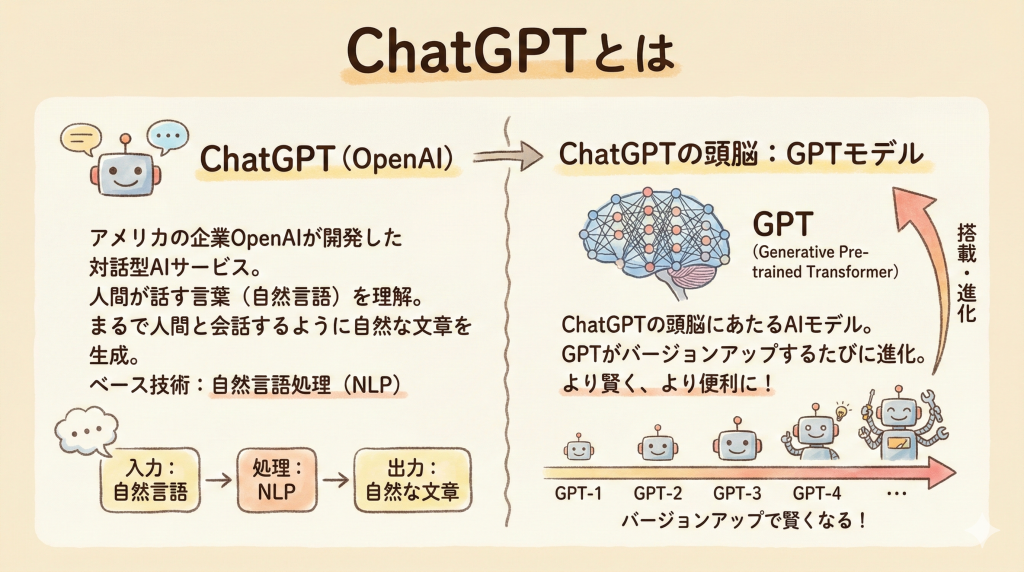

ChatGPTは、アメリカの企業OpenAIが開発した対話型のAIサービスです。

人間が話す言葉(自然言語)を理解し、まるで人間と会話しているかのように自然な文章を生成することができます。この技術のベースになっているのが、自然言語処理(NLP)という分野の研究成果です。

ChatGPTの頭脳にあたるのが「GPT(Generative Pre-trained Transformer)」と呼ばれるAIモデルです。このGPTモデルがバージョンアップするたびに、処理できるデータ量や速度が桁違いに向上し、より賢く便利に進化してきました。

対話型AIの変遷とChatGPTの歴史(スペック比較表)

GPTモデルは、1から始まり現在に至るまで、パラメータ数(脳細胞のつながりの数)を爆発的に増やしながら進化してきました。まずはその変遷と具体的なカタログ値を表でざっくりと把握しましょう。

| モデル名 | リリース時期 / 規模 | 解説と具体スペック |

|---|---|---|

| GPT-1 | 2018年 1.17億パラメータ |

Transformerモデルを採用した最初期のGPT。まだ対話能力は低く、実験的な位置づけでした。 |

| GPT-2 | 2019年 15億パラメータ |

パラメータ数が10倍以上に。精度が飛躍的に向上し、「あまりに自然な文章が書けるため、悪用されると危険」として論文公開が延期されたエピソードが有名です。 |

| GPT-3 | 2020年 1750億パラメータ |

パラメータ数が一気に100倍以上に巨大化。圧倒的な文章生成能力を持ちましたが、まだ「嘘」や「不適切な発言」も多い状態でした。 |

| InstructGPT | 2022年1月 | GPT-3をベースに、人間の指示(Instruction)に従うようにファインチューニング(微調整)したモデル。ChatGPTの直接的な祖先です。 |

| GPT-3.5 | 2022年11月 ChatGPT公開 |

無料版ChatGPTとして公開され世界に衝撃を与えました。最大で約1.2万文字(16Kトークン)の文章を一度に処理でき、RLHF(後述)により対話の自然さが劇的に向上しました。 |

| GPT-4 | 2023年3月 推定1兆パラメータ超 |

画像も理解できるマルチモーダルに対応。最大約9.6万文字(128Kトークン=文庫本1冊弱)を一度に処理可能。米国の米国司法試験(Bar Exam)で上位10%の成績を収めるほどの推論能力を持ちます。 |

| GPT-4o | 2024年5月 リアルタイム処理 |

“o”はOmni(全能)の意。音声・視覚・テキストをネイティブに統合。音声入力に対する応答速度が平均320ミリ秒と、人間の会話リズムと同等レベルに達しました。 |

| GPT-o1 | 2024年9月 思考力特化 |

出力前に複雑な問題を内部で「じっくり推論(Chain of Thought)」する新シリーズ。国際数学オリンピック(IMO)の予選レベルの問題で83%の正答率(GPT-4oは13%)を叩き出すなど、理数系に圧倒的な強さを誇ります。 |

| 将来モデル | 開発中 | GPT-5やGPT-o3などがロードマップとして噂されており、さらなるパラメータの巨大化と処理効率の向上が見込まれています。 |

ChatGPTの仕組みと重要キーワード

カタログ値を支える、裏側の重要な技術用語を解説します。試験では言葉の意味が頻出なので要チェックです。

パラメータとデータセット

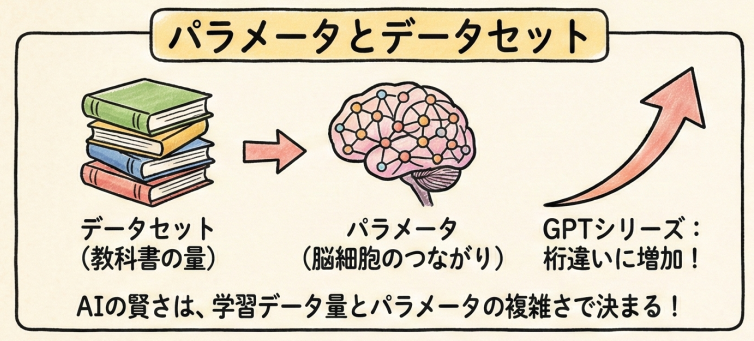

AIの賢さは、学習に使ったデータの量(データセット)と、ニューラルネットワークの複雑さを示す変数(パラメータ)で決まります。

パラメータは「脳のシナプスの数」に例えられ、GPT-3の「1750億」から、GPT-4では「数兆規模(非公開)」に達していると推測されており、これが知能の劇的なジャンプを生み出しました。

コンテキストウィンドウ(トークン数)

カタログ値を見る際、「〇〇Kトークン」という言葉がよく出ます。これは「AIが1回のやり取りで記憶・処理できる文字の量(コンテキスト長)」のことです。

英語では1トークン=約0.8単語、日本語では1トークン=約1文字弱に相当します。この数値が大きいほど、長文の要約や大量の資料の読み込みが得意になります。

RLHFとアライメント

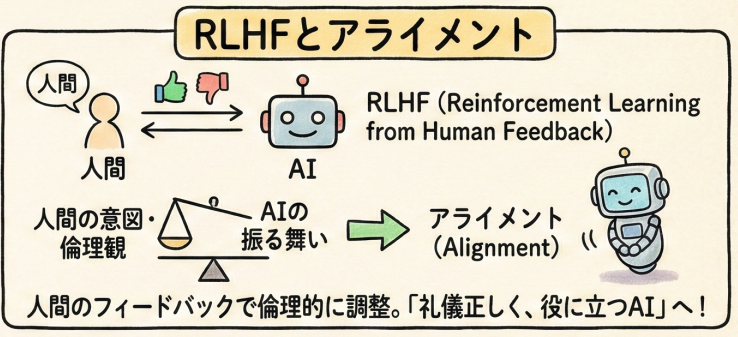

GPT-3までのAIは、単に「ネット上の文章の続きを確率で予測する」だけだったので、差別用語や嘘も平気で出力していました。そこで導入されたのがRLHF(人間のフィードバックによる強化学習)です。

- アライメント(Alignment):AIの振る舞いを、人間の意図や倫理観(役に立つか、無害か、正直か)に合わせること。

人間がAIの回答を採点し、「こちらの回答の方が倫理的で良い」と教え込むことで、ChatGPTは「礼儀正しく、役に立つAI」になりました。

ハルシネーション(Hallucination)

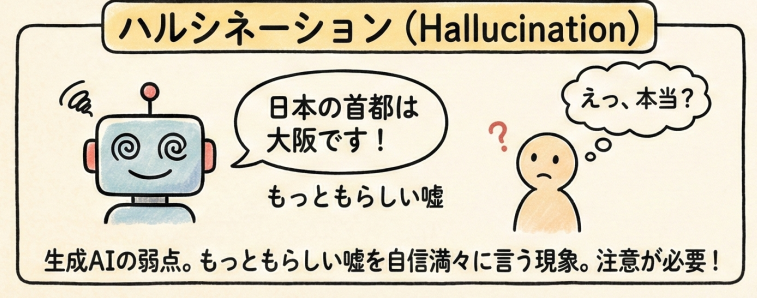

生成AIの最大の弱点がハルシネーション(幻覚)です。これは、AIが「もっともらしい嘘」を自信満々に答えてしまう現象のことです。

GPT-4以降では精度が大きく向上しましたが、内部的には確率的な文章生成を行っているため、完全にゼロにはなっていません。「AIは嘘をつくことがある」という前提で使う必要があります。

マルチモーダル

マルチモーダルとは、テキスト(文字)だけでなく、画像、音声、動画など、複数の種類のデータを一度に扱える能力のことです。

GPT-4以降は、冷蔵庫の中身の写真をアップロードして「これで作れる料理は?」と聞いたり、手書きのラフ画からWebサイトのコードを生成させたりといった使い方が可能になっています。

ChatGPTの機能拡張と関連ツール

ChatGPTは単に会話するだけでなく、様々なツールと連携して機能を拡大しています。

Code Interpreter(Advanced Data Analysis)

ChatGPTの中で、プログラミング言語(Python)を自動生成・実行できる機能です。

ExcelやCSVファイルを読み込ませて数秒でグラフを描かせたり、複雑な計算をプログラムにやらせることで「AIの計算ミス」を防ぐことができます。

GPTs

特定の目的に特化した「自分専用のカスタマイズ版ChatGPT」を作れる機能です。プログラミングの知識がなくても、自然言語で「あなたは優秀な翻訳家です。〇〇のトーンで訳して」などと設定するだけで作成でき、他のユーザーと共有(GPT Store)することも可能です。

Image Generation(画像生成)

会話の中で画像を作れる機能です。裏側ではOpenAIの画像生成モデル「DALL-E 3(ダリスリー)」が動いており、プロンプトの指示に忠実な画像を生成します。

Codex

OpenAIが開発した、プログラミングコードの生成に特化したモデルです。Microsoftが提供する開発者向け支援ツール「GitHub Copilot」などのベース技術になっています。

OpenAIのその他のモデル・将来の展望

OpenAIはテキスト生成以外にも、次世代のマルチモーダルAIを開発しています。

- Sora:最長1分間の、物理法則を理解したかのような高精細でリアルな動画をテキストから生成できるAIモデル。

- Operator:ブラウザやPC操作などを人間に代わって自律的に実行する「AIエージェント」として開発が進められているプロジェクト。

- 次世代GPT:人間と同等以上の汎用的な知能(AGI=汎用人工知能)を目指して研究開発が続けられています。

競合サービスとの関係

ChatGPTの成功を受け、他社からもカタログスペックでChatGPTを凌駕するような強力なライバルが登場しています。

- Gemini(ジェミニ):Googleが開発。最大200万トークン(本数十冊分)という圧倒的なコンテキスト長を誇り、Google Workspace(ドキュメントやスプレッドシート)との強力な連携が強み。

- Claude(クロード):Anthropic社が開発。Claude 3.5シリーズなどは非常に自然な日本語表現と高いコーディング能力に定評があり、ビジネス層に人気。

- Copilot(コパイロット):Microsoftが提供。内部でGPT-4などのOpenAIモデルをベースにしており、WordやExcel、TeamsなどのOffice製品に組み込まれて連携できるのが最大の特徴。

まとめ

今回の記事では、ChatGPTの仕組みと進化の歴史について解説しました。

- GPT-1〜3でパラメータ数を増やして基礎能力を高め、GPT-3.5とRLHFで対話AIとして完成した。

- GPT-4でマルチモーダル(画像・音声対応)になり、司法試験上位レベルの推論能力を獲得した。

- 最新のGPT-4oはリアルタイム性を、GPT-o1は理数系の深い推論力を強化している。

- 性能が上がってもハルシネーション(もっともらしい嘘)のリスクは残るため注意が必要。

試験では、各モデルの代表的なスペック・特徴(「GPT-4のマルチモーダル化」「o1の推論強化」など)や、技術用語(RLHF、トークン、アライメント)の意味が問われます。表や数値を手掛かりにして整理しておきましょう!

コメント