AI技術の急速な発展に伴い、日本でもついにAIに関する新しい法律が整備されました。

これまでAIのルールといえば「ガイドライン(努力目標)」が中心でしたが、法的拘束力を持つ「法律」ができたことで、事業者はより厳格な対応を求められるようになります。

この記事では、2025年6月4日に交付された「AI新法(人工知能関連技術の研究開発及び活用の推進に関する法律)」について、その概要や制定の背景、私たち事業者が気をつけるべきポイントをわかりやすく解説します。

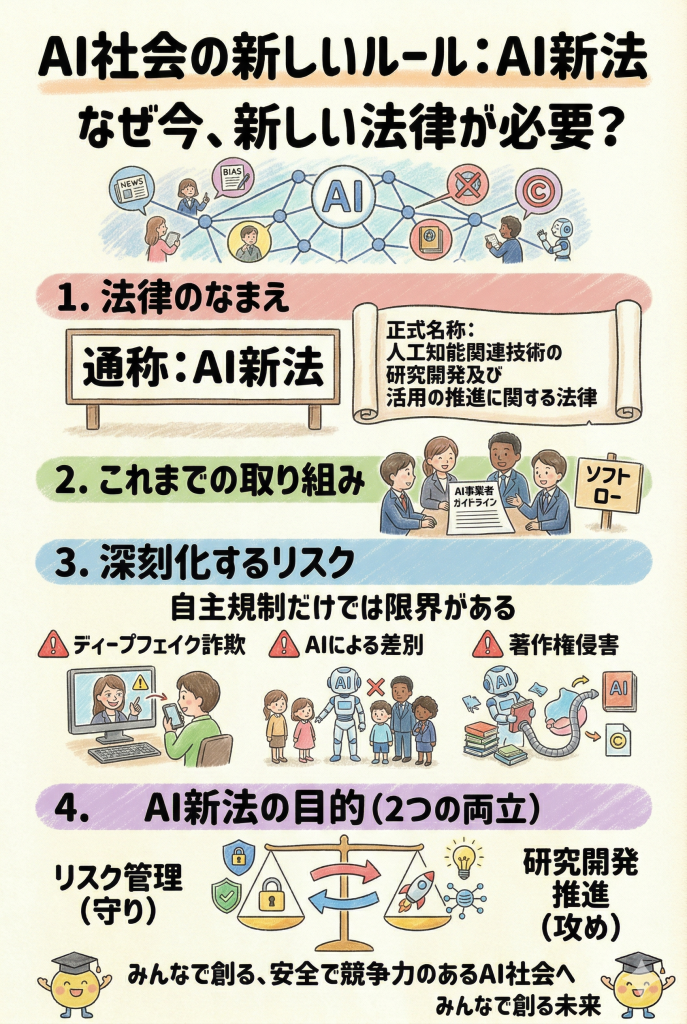

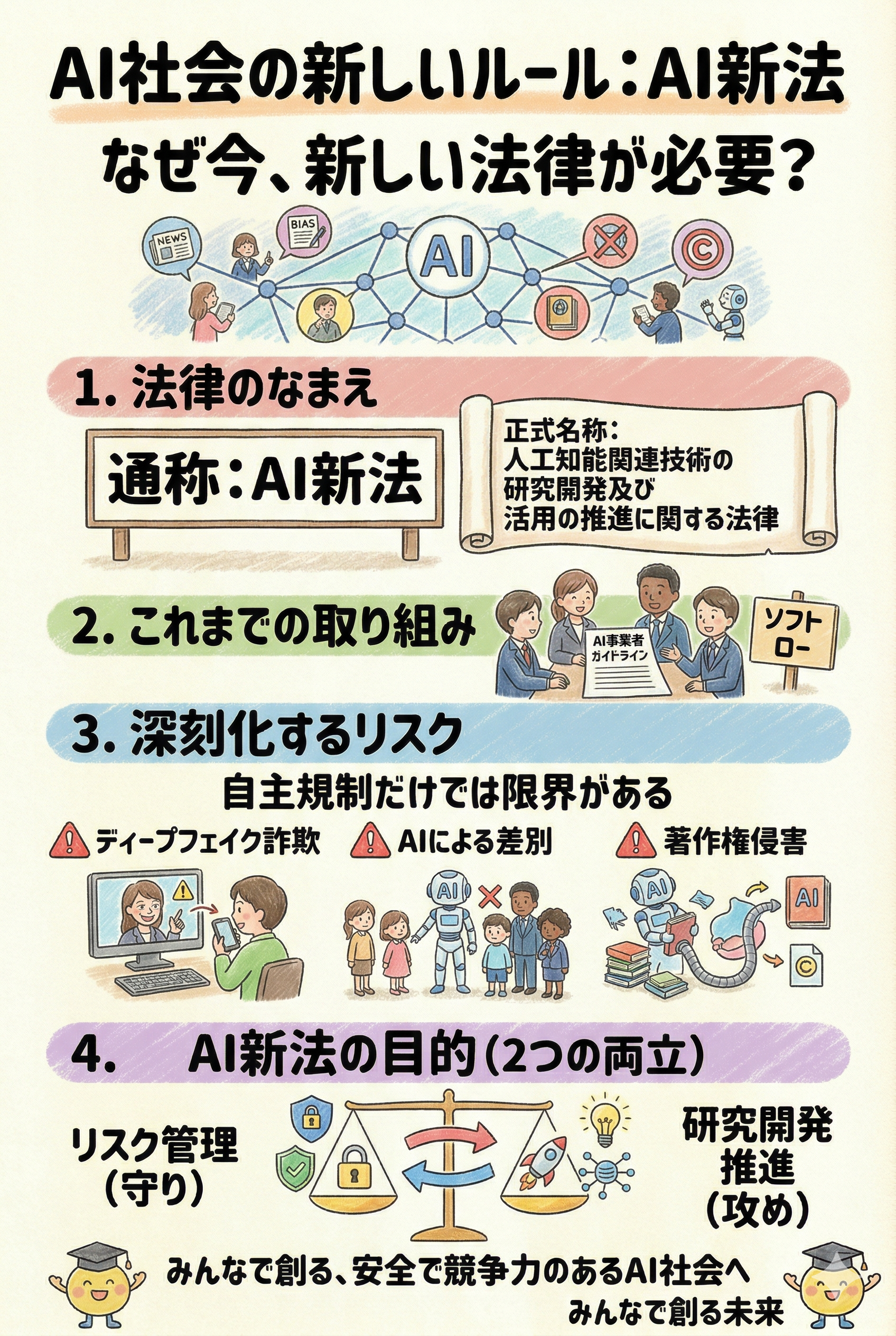

AI新法の必要性

なぜ今、新しい法律が必要になったのでしょうか?

その背景には、AI技術が社会に与える影響が大きくなりすぎたことがあります。

法律の正式名称と通称

- 正式名称:人工知能関連技術の研究開発及び活用の推進に関する法律

- 通称:AI新法

制定の理由

これまで日本は「AI事業者ガイドライン」などを通じて、企業の自主的な取り組み(ソフトロー)を尊重してきました。

しかし、ディープフェイクによる詐欺や、AIによる差別、著作権侵害などのリスクが深刻化し、「自主規制だけでは限界がある」という声が高まりました。

そこで、「AIのリスクを管理しつつ、研究開発を推進して日本の競争力を高める」という2つの目的を両立させるために、この法律が作られました。

AI新法の基本構造

この法律は、単に「AIを規制して縛り付ける」ものではありません。名称に「推進」とある通り、AIを安全に発展させるための土台作りが目的です。

基本的には以下の3つの柱で構成されています。

- 基本理念の策定:「人間中心のAI社会」を実現するための基本的な考え方。

- 国の責務:国がAI開発を支援したり、必要な規制を作ったりする責任。

- 事業者の責務:AIを作る人(開発者)、提供する人(プロバイダ)、使う人(利用者)が守るべきルール。

AI新法の内容

AI新法では、具体的にどのようなことが定められているのでしょうか。重要なポイントは「リスクに応じた対応(リスクベース・アプローチ)」です。

すべてのAIを厳しく規制するわけではありません。AIをその用途や影響度によって分類し、リスクが高いものほど厳格なルールを適用します。

- 高リスクAIへの規制:人命に関わる医療AIや、インフラ管理、採用判定システムなど、失敗すると人権や生命に危険が及ぶAIについては、人間による監視や透明性の確保が義務付けられます。

- 開発・活用の促進:安全なAIを開発する企業への支援や、データ利用環境の整備などが盛り込まれています。

注意すべき具体的なリスク

この法律が特に対処しようとしているのは、以下のような具体的なリスクです。

- 人権侵害・差別:AIの判断によって、就職やローン審査で不当な差別が起きること。

- 誤情報の拡散:生成AIがもっともらしい嘘(ハルシネーション)をついたり、偽情報(ディープフェイク)を大量に生成したりすること。

- 犯罪への悪用:サイバー攻撃や詐欺にAIが使われること。

- プライバシー侵害:個人の行動データや顔データが無断で収集・利用されること。

事業者は、自分たちが使うAIがこれらのリスクを引き起こさないか、常にチェックする必要があります。

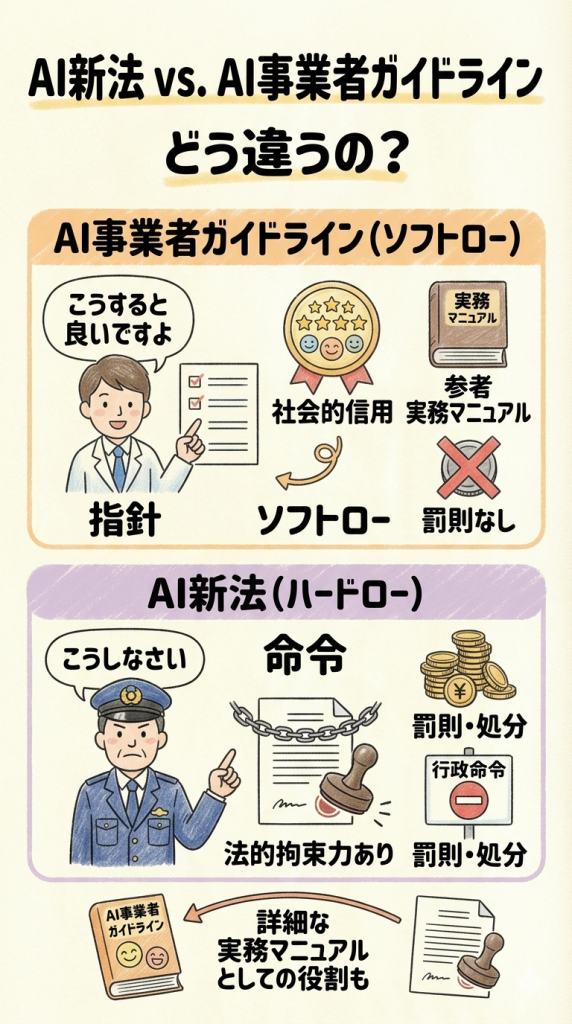

AI事業者ガイドラインとの関連

すでに存在している「AI事業者ガイドライン」と、今回の「AI新法」はどう違うのでしょうか?

- AI事業者ガイドライン(ソフトロー):「こうすると良いですよ」という指針。守らなくても罰則はないが、社会的な信用に関わる。法律の詳細な実務マニュアルとしての役割も持つ。

- AI新法(ハードロー):「こうしなさい」という命令。法的拘束力があり、違反すると罰則や行政処分の対象になる可能性がある。

AI新法は、ガイドラインの内容をベースにしつつ、特に重要な部分を法律として義務化したものです。

そのため、これまでは「ガイドラインを見ておけばOK」だったのが、今後は「法律(義務)+ガイドライン(推奨事項)」の両方を理解して遵守する必要があります。

まとめ

今回の記事では、2025年6月に交付されたAI新法について解説しました。

- 正式名称は「人工知能関連技術の研究開発及び活用の推進に関する法律」。

- 規制だけでなく、開発の推進も目的としている。

- リスクの大きさに応じてルールを変えるリスクベース・アプローチを採用している。

- ガイドライン(努力目標)と違い、法的拘束力があるため、事業者は対応が必須となる。

AIを活用する企業にとって、この法律の理解は避けて通れません。「知らなかった」では済まされない重要な転換点ですので、しっかり概要を押さえておきましょう!

コメント