AIは私たちの生活を便利にする強力なツールですが、使い方を間違えれば差別を助長したり、プライバシーを侵害したりする恐れがあります。

そのため、日本では国(内閣府や経済産業省など)が中心となって、「AIとどう付き合っていくべきか」というルールや理念を定めています。

この記事では、生成AIパスポート試験で問われる「AI社会原則」や「AI事業者ガイドライン」の重要ポイントを、わかりやすく解説します。これらはAIを開発・提供・利用するすべての人が守るべき「憲法」のようなものです。

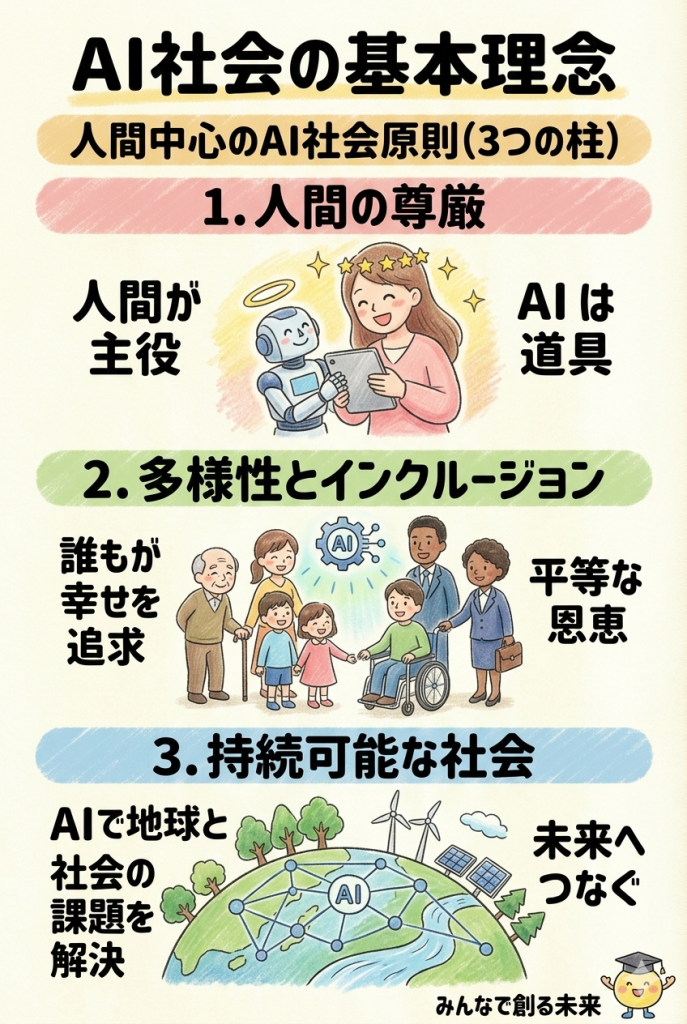

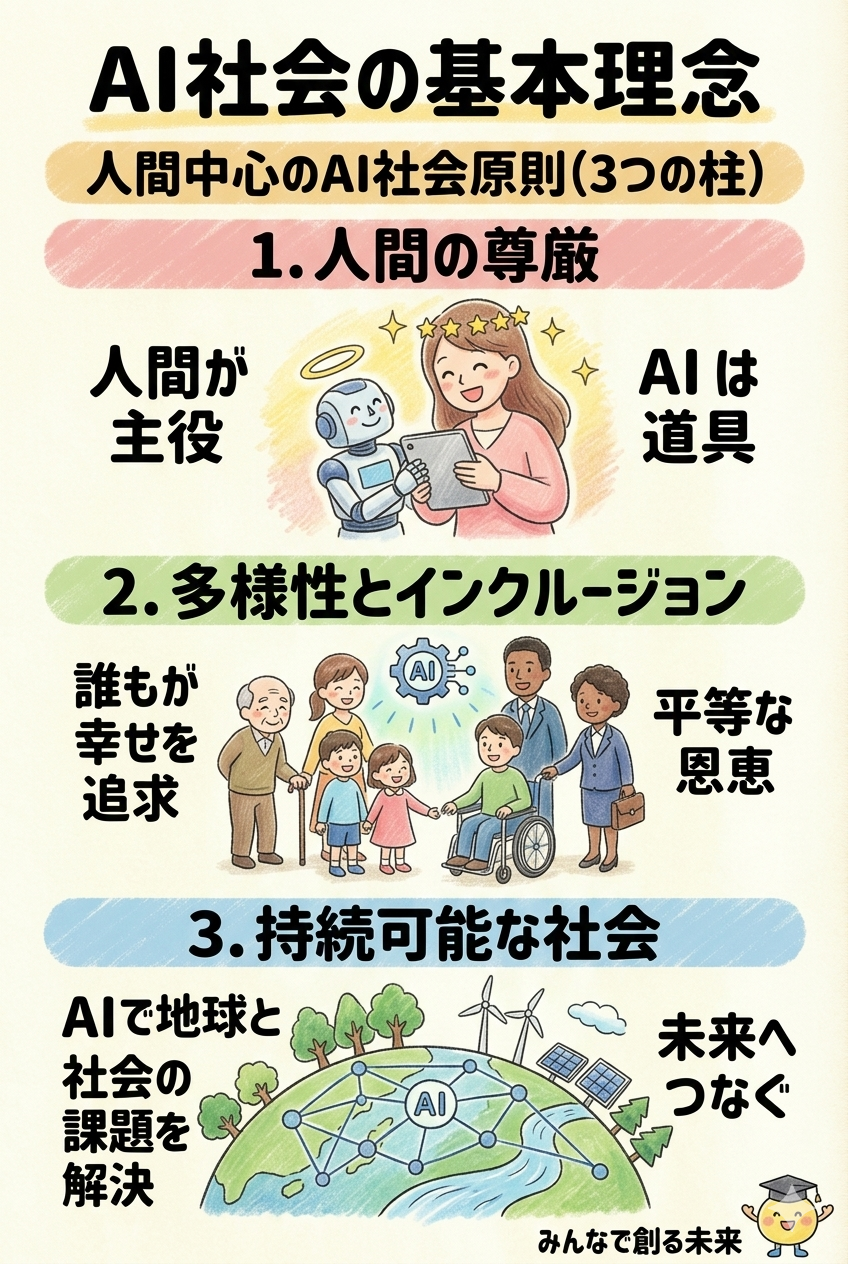

AI社会の基本理念

日本が目指す「AIを活用した社会」は、どのような姿をしているべきでしょうか。

内閣府が策定した「人間中心のAI社会原則」では、以下の3つの基本理念(Society 5.0の理念)が掲げられています。

- 人間の尊厳が尊重される社会(Dignity):AIはあくまで人間のための道具です。人間がAIに支配されたり、AIによって人間の尊厳が傷つけられたりしてはいけません。「人間が主役」という大前提です。

- 多様な背景を持つ人々が多様な幸せを追求できる社会(Diversity & Inclusion):性別、年齢、国籍、障害の有無などに関わらず、AIの恩恵を平等に受けられ、それぞれの幸せを追求できる社会を目指します(ダイバーシティ&インクルージョン)。

- 持続可能な社会(Sustainability):地球環境問題や社会的な格差を、AIの力で解決し、未来にわたって持続可能な社会を作っていきます(サステナビリティ)。

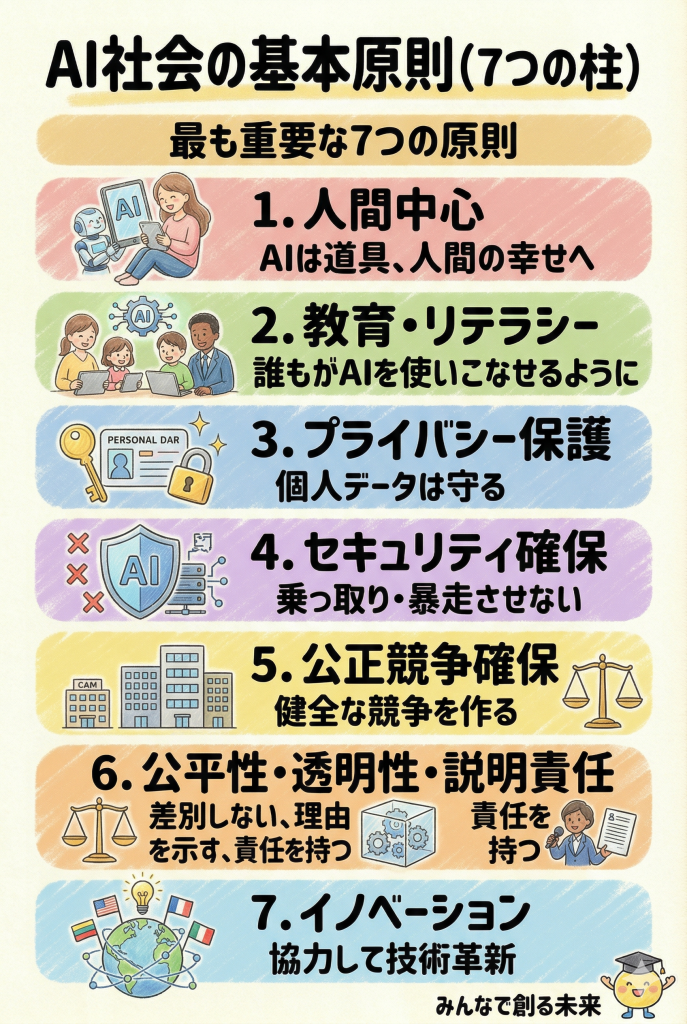

AI社会原則と共通の指針

上記の基本理念を実現するために、私たちが守るべき具体的なルールが「AI社会原則」です。

これらは、AIに関わるすべての人が意識すべき「共通の指針」となっています。

最も重要な7つの原則

- 人間中心の考え方:AIは人間の能力を拡張し、幸福を追求するために使われるべきであること。

- 教育・リテラシー:誰もがAIを使いこなせるよう、教育の機会を提供すること。

- プライバシー保護:個人のデータが勝手に使われないよう守ること。

- セキュリティ確保:AIシステムが乗っ取られたり暴走したりしないよう安全性を保つこと。

- 公正競争確保:一部の巨大企業だけがAIを独占せず、健全な競争環境を作ること。

- 公平性、アカウンタビリティ(説明責任)及び透明性:

- 公平性:AIが特定のグループを差別しないこと。

- 透明性:AIがどうやってその結論を出したのか、ブラックボックスにしないこと。

- アカウンタビリティ:AIの結果について、誰が責任を持つのかを明確にし、説明できるようにすること。

- イノベーション:国境や分野を超えて協力し、技術革新を進めること。

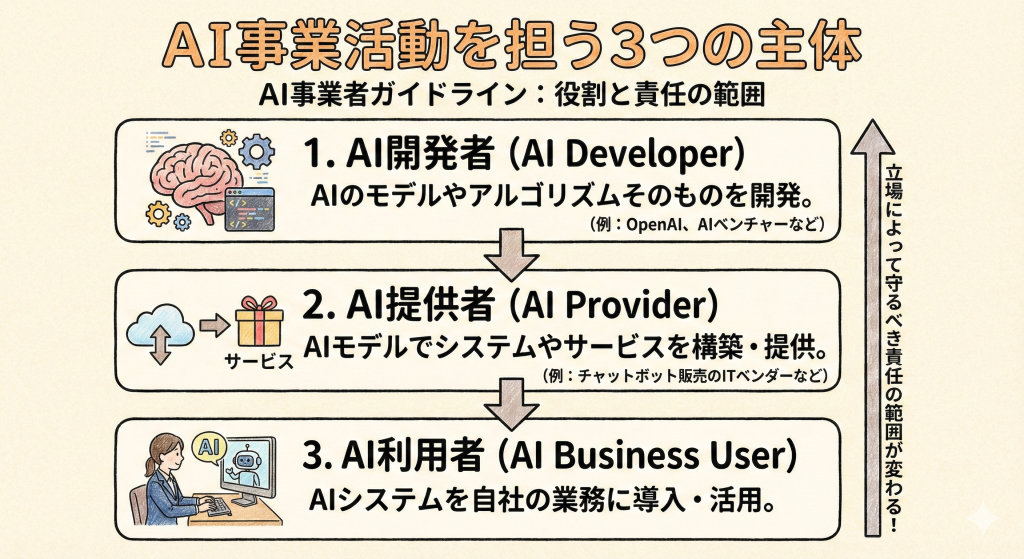

AIの事業活動を担う3つの主体

「AI事業者ガイドライン」では、AIに関わるビジネスを行う人を以下の3つの役割(主体)に分けています。

自分がどの立場にいるかによって、守るべき責任の範囲が変わってきます。

- AI開発者(AI Developer):AIのモデルやアルゴリズムそのものを開発する人や企業です。(例:OpenAIなどの研究所、AIベンチャーなど)

- AI提供者(AI Provider):開発されたAIモデルを使って、具体的なシステムやサービスを構築し、他者に提供する人や企業です。(例:チャットボットシステムを販売するITベンダーなど)

- AI利用者(AI Business User):提供されたAIシステムを自社の業務に導入し、活用する人や企業です。※ここでの「利用者」は、一般消費者ではなく、AIを使ってビジネスをする「企業(ユーザー企業)」を指します。

(例:AIを使ってコールセンター業務を行う会社など)

高度なAIシステムに関係する事業者に共通の指針として、これら3者はそれぞれ連携し、リスク情報の共有やステークホルダーへの説明責任を果たすことが求められます。

AIガバナンスの構築

企業がAIを安全に使い続けるためには、組織として管理する仕組み(AIガバナンス)が必要です。

ただ「気をつける」だけでなく、以下のようなシステムを作ることが推奨されています。

1. 環境・リスク分析

「自社のAIがどんなリスクを持っているか?」を分析します。

例えば、「採用面接AI」なら差別のリスク、「自動運転AI」なら事故のリスクといったように、AIの用途に応じたリスクを洗い出します。

2. AIガバナンス・ゴール

分析したリスクに対して、「どのレベルまで安全性を確保するか」という目標(ゴール)を定めます。

「絶対に事故を起こさない」「説明できるようにする」といった具体的な目標です。

3. AIマネジメントシステム

定めたゴールを達成するために、実際に組織を動かす仕組みです。

「誰がチェックするか」「問題が起きたらどう報告するか」といったルールを決め、継続的に運用・改善していきます。

まとめ

今回の記事では、日本におけるAIの社会的なルールについて解説しました。

- 基本理念は「Dignity(尊厳)」「Diversity & Inclusion(多様性)」「Sustainability(持続可能性)」の3つ。

- 原則の中でも「人間中心」「アカウンタビリティ(説明責任)」「透明性」は特に重要。

- AIビジネスの主体は「開発者」「提供者」「利用者(ビジネスユーザー)」の3つに分類される。

- 企業はリスクを分析し、AIガバナンス(管理体制)を構築する必要がある。

試験では、「AI開発者とAI提供者の違いは?」や「AI社会原則に含まれないものはどれか?」といった問題が出やすいです。それぞれの定義をしっかり整理しておきましょう!

コメント